Аудит AI-сгенерированного кода

Сделайте приложение, созданное с помощью ИИ, готовым к продакшену — устраните уязвимости, оптимизируйте расходы на API и предотвратите утечки данных

От AI-прототипа до продакшена

Проблема кода, написанного ИИ

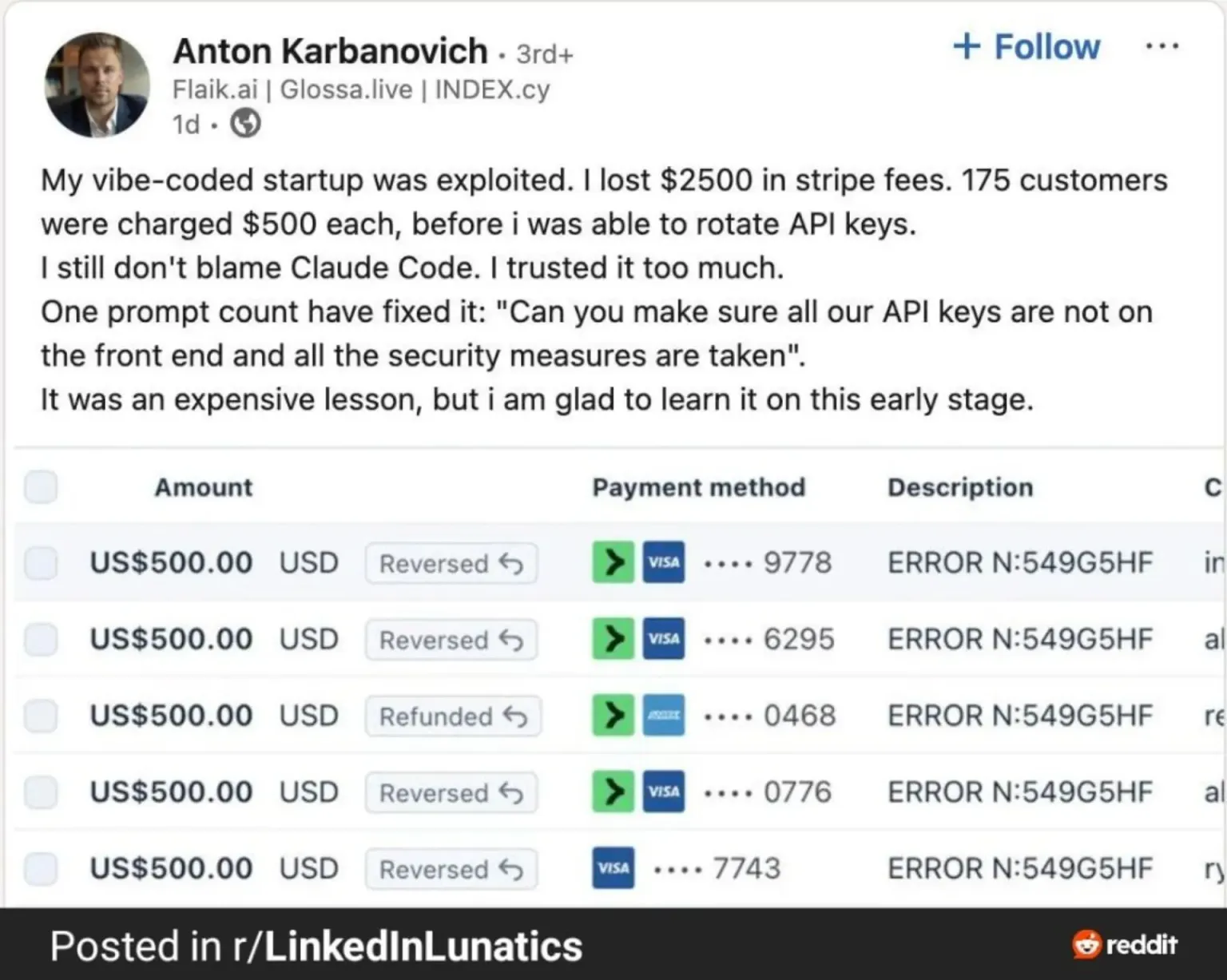

Инструменты вроде Cursor, Bolt, Lovable и ChatGPT позволяют любому создать работающее приложение. Прототип выглядит отлично. Работает локально. Вы показываете его инвесторам или первым пользователям, получаете положительный отклик. Потом деплоите в продакшен — и начинаются проблемы.

AI-агенты пишут код, который работает, но не пишут код, готовый к продакшену. Они не думают о том, что произойдёт при росте нагрузки. Не учитывают, что может сделать злоумышленник. Не оптимизируют расходы. Результат — приложение, которое корректно функционирует на демо, но сжигает бюджет, сливает данные или ломается под реальным трафиком.

Эти цифры подтверждены независимыми исследованиями: Veracode протестировал 100+ LLM и обнаружил, что 45% сгенерированного кода проваливает тесты безопасности. Анализ Apiiro за 2025 год показал, что AI-разработчики раскрывают учётные данные почти вдвое чаще. Исследователи NYU нашли уязвимости в ~40% программ, сгенерированных Copilot, а исследование Стэнфорда подтвердило, что разработчики с AI-помощниками пишут менее безопасный код — и при этом больше уверены в его надёжности.

Что идёт не так в приложениях, созданных ИИ

Мы провели аудит десятков AI-сгенерированных кодовых баз. Одни и те же категории проблем появляются практически в каждой. Это не исключения — это системные слепые пятна, которые AI-инструменты стабильно пропускают.

Уязвимости безопасности

- Открытые API-ключи и секреты

AI-инструменты часто хардкодят API-ключи, учётные данные баз и токены сторонних сервисов прямо в исходный код. Они попадают в публичные репозитории, клиентские бандлы или файлы окружения, которые уходят в продакшен. Один утёкший ключ OpenAI может сгенерировать тысячи долларов несанкционированного расхода за несколько часов.

- Отсутствие аутентификации и авторизации

AI-приложения часто реализуют аутентификацию на поверхностном уровне — экран логина есть, но бэкенд на самом деле не проверяет права. API-эндпоинты принимают любой запрос. Административные маршруты доступны без проверки ролей. Пользователь A может видеть данные пользователя B, просто подменив ID в URL.

- Инъекционные атаки

SQL-инъекции, XSS и промпт-инъекции распространены в AI-коде. AI-модели генерируют код, который конкатенирует пользовательский ввод напрямую в запросы, HTML или промпты LLM без санитизации. Один уязвимый эндпоинт может скомпрометировать всю базу данных или позволить злоумышленникам манипулировать поведением вашего ИИ.

- Небезопасное хранение данных

Персональные данные в открытом виде, сессионные токены в localStorage, пароли хешированные MD5 или вообще без хеширования. AI-инструменты выбирают простейшую реализацию, которая редко бывает безопасной. Соответствие GDPR и требованиям конфиденциальности, как правило, отсутствует.

Оптимизация расходов на API

- Избыточные вызовы API

Самая дорогая проблема, которую мы находим. AI-приложения делают лишние вызовы к платным сторонним API — геокодинг, финансовые данные, AI-модели, сервисы верификации. Они запрашивают одни и те же данные повторно, не кэшируют ответы и делают запросы, которых можно было бы избежать простой локальной логикой. Мы регулярно находим приложения, где 60-80% расходов на API — впустую.

- Отсутствие лимитов и бюджетов

Нет лимитов на пользователя. Нет дневных лимитов расходов. Нет автоматических выключателей при скачке затрат. Один пользователь — или бот — может выжечь весь ваш месячный бюджет за день. AI-инструменты никогда не реализуют контроль затрат, потому что не имеют представления о вашей бизнес-модели и тарифах интегрируемых сервисов.

- Отсутствие кэширования и батчинга

Запрос одного и того же курса валюты, геолокации по IP или профиля пользователя из платного API при каждом обращении вместо кэширования. Индивидуальные вызовы API в цикле вместо использования пакетных эндпоинтов. Каждый лишний запрос стоит денег, и при масштабировании это складывается в тысячи долларов в месяц.

Утечки данных и конфиденциальность

- Логирование конфиденциальной информации

AI-код обожает избыточное логирование. Email-адреса, пароли, платёжные данные и персональная информация попадают в логи приложения, сервисы трекинга ошибок и сторонние аналитические системы. Эти логи часто доступны без аутентификации и хранятся бессрочно.

- Избыточные ответы API

API-ответы, возвращающие целые объекты пользователя — включая хешированные пароли, внутренние ID, email-адреса и метаданные — когда фронтенду нужно только отображаемое имя. GraphQL-эндпоинты без ограничений глубины, позволяющие злоумышленникам извлечь всю модель данных.

- Передача данных третьим сторонам

AI-инструменты интегрируют аналитику, трекинг ошибок и мониторинг без учёта того, какие данные в них уходят. Поведение пользователей, персональная информация и бизнес-данные оказываются в сторонних системах без согласия, нарушая GDPR и другие требования конфиденциальности.

Что охватывает наш аудит

Сканирование уязвимостей

OWASP Top 10, инъекционные атаки, обход аутентификации, утечка секретов

Анализ расходов на API

Профилирование платных API, избыточные вызовы, возможности кэширования, прогноз расходов

Обнаружение утечек данных

Анализ логов, аудит API-ответов, маппинг потоков данных к третьим сторонам

Проверка производительности

Запросы к базе данных, проблемы N+1, утечки памяти, ёмкость под нагрузкой

Аудит инфраструктуры

Конфигурация деплоя, изоляция окружений, резервное копирование и восстановление

Проверка соответствия

Готовность к GDPR, политики хранения данных, механизмы согласия

Процесс аудита

Мы даём полный аудит с конкретными исправлениями — не просто список проблем.

Как это работает

- Доступ и определение объёма

Вы предоставляете нам доступ на чтение к репозиторию и развёрнутому окружению. Мы определяем объём аудита на основе ваших приоритетов: полный аудит или фокус на конкретных направлениях (безопасность, расходы или конфиденциальность). Никаких изменений в коде на этапе аудита.

- Автоматический анализ

Мы запускаем статический анализ, сканирование уязвимостей зависимостей, обнаружение секретов и профилирование расходов на API. Это ловит очевидные проблемы — известные уязвимости, открытые учётные данные, устаревшие пакеты с патчами безопасности и явные проблемы производительности.

- Ручная экспертная проверка

Наши инженеры вручную проверяют архитектуру, бизнес-логику, потоки аутентификации, API-интеграции и обработку данных. Именно здесь мы находим то, что пропускают автоматизированные инструменты: логические ошибки, пробелы авторизации, возможности оптимизации расходов и проектные проблемы, которые проявятся при масштабировании.

- Отчёт и приоритизация

Мы предоставляем детальный отчёт, где каждая находка категоризирована по критичности (критическая, высокая, средняя, низкая) и типу (безопасность, расходы, конфиденциальность, производительность). Каждая находка включает понятное описание риска, proof of concept где применимо и конкретную рекомендацию по исправлению с примерами кода.

- Внедрение исправлений

По желанию мы реализуем исправления сами. Критические патчи безопасности применяются первыми, за ними следуют оптимизации расходов и улучшения конфиденциальности. Вы проверяете каждое изменение перед мержем. Результат — кодовая база, готовая к продакшену, которую можно деплоить с уверенностью.

AI-код vs продакшен-код

Что меняется после профессионального аудита

| Аспект | После аудитаProduction-Ready | AI-код | Разработка с нуля |

|---|---|---|---|

| Безопасность | Закалённая | Поверхностная | Зависит от команды |

| Расходы на API | Оптимизированы | Перерасход в 5-20x | Обычно оптимизированы |

| Конфиденциальность | Соответствие GDPR | Утечки данных | Зависит от процесса |

| Время до продакшена | 2-4 недели | Уже работает | 3-6 месяцев |

| Стоимость запуска | Низкая (стоимость аудита) | Бесплатно (рискованно) | Высокая (полная разработка) |

| Обработка ошибок | Корректное восстановление | Падения в крайних случаях | Обычно обработаны |

| Масштабируемость | Протестирована под нагрузкой | Не протестирована | Архитектурно заложена |

| Мониторинг | Полная наблюдаемость | Нет или избыточный | Стандартная настройка |

Суть: AI-код позволяет пройти 80% пути за 5% времени. Но оставшиеся 20% — безопасность, оптимизация расходов, конфиденциальность данных, обработка ошибок — отделяют демо от продакшен-приложения. Аудит закрывает этот разрыв, не выбрасывая то, что уже создано с помощью ИИ.

Стоимость аудита AI-сгенерированного кода

Прозрачные тарифы в зависимости от объёма кодовой базы и области аудита

Безопасность

Только критические уязвимости

1-2 недели

- Сканирование уязвимостей OWASP Top 10

- Обнаружение секретов и учётных данных

- Проверка аутентификации и авторизации

- Проверка уязвимостей зависимостей

- Приоритизированный отчёт по находкам

- Рекомендации с примерами кода

Оптимизация расходов

Сократите расходы на API

1-2 недели

- Профилирование платных API

- Выявление избыточных вызовов

- Стратегия кэширования и батчинга

- План внедрения rate limiting

- Оптимизация стоимости запросов

- Отчёт с прогнозом экономии

Полный аудит

Полная готовность к продакшену

2-4 недели

- Всё из раздела «Безопасность»

- Всё из раздела «Оптимизация расходов»

- Проверка конфиденциальности и GDPR

- Анализ производительности и масштабируемости

- Аудит инфраструктуры

- Детальный отчёт + внедрение исправлений

Поддержка

Постоянный аудит и мониторинг

в месяц

- Ежемесячные проверки безопасности

- Мониторинг расходов на API и алерты

- Ревью обновлений зависимостей

- Проверка безопасности новых функций

- Приоритетное реагирование на инциденты

- Прямой доступ через Slack/Telegram

Доступно индивидуальное ценообразование

Стоимость зависит от размера кодовой базы, количества сервисов и интеграций, а также объёма аудита. Небольшое односервисное приложение с одной AI-интеграцией будет стоить ближе к нижней границе. Мультисервисная платформа с несколькими AI-провайдерами, процессингом платежей и пользовательскими данными потребует более тщательной проверки. Свяжитесь с нами для бесплатной первичной оценки.

Часто задаваемые вопросы

Ответы на частые вопросы об аудите AI-сгенерированного кода

Да. Мы проводим аудит кода независимо от того, как он был сгенерирован. Cursor, Bolt, Lovable, Claude, ChatGPT, GitHub Copilot или любая комбинация AI-инструментов — процесс аудита одинаков. На выходе — код, и именно его мы проверяем. У нас есть опыт со всеми основными AI-инструментами, и мы знаем их типичные ошибки.

Готовы сделать AI-приложение боевым?

Давайте проведём аудит вашего кода и превратим AI-прототип в безопасное, экономичное приложение, которое можно уверенно запускать в продакшен.